Posts alegam que vídeos autênticos foram gerados com IA para alimentar rumor sobre morte de Netanyahu

- Publicado em 24 de março de 2026 às 19:31

- 7 minutos de leitura

- Por Cintia NABI CABRAL, Pierre MOUTOT, AFP França

- Tradução e adaptação AFP Brasil

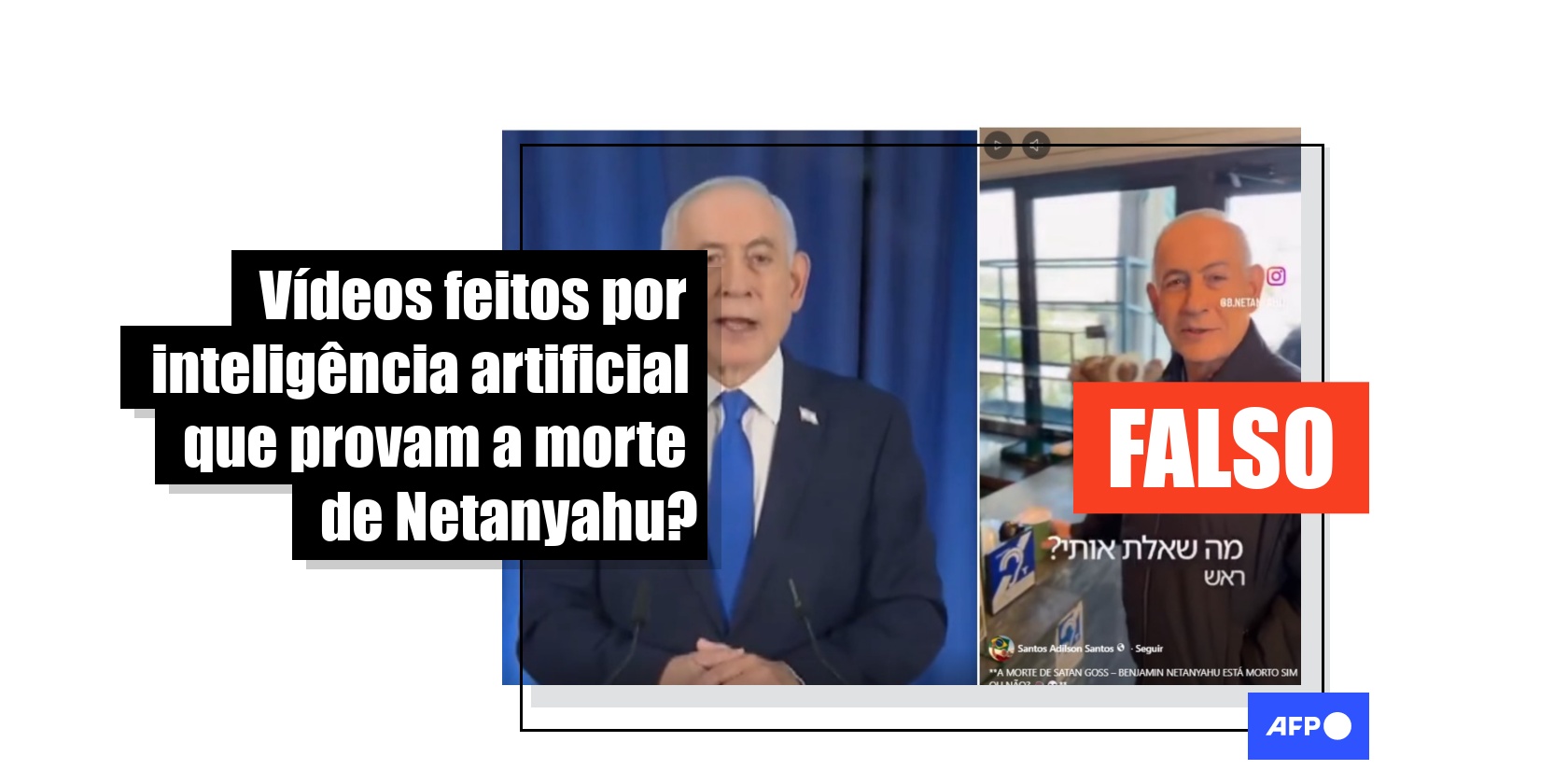

Em 12 de março de 2026, o primeiro-ministro de Israel, Benjamin Netanyahu, se pronunciou pela primeira vez sobre a guerra conjunta com os Estados Unidos contra o Irã. Nas redes sociais, internautas alegaram que o vídeo foi gerado por inteligência artificial (IA) e questionaram se o líder estaria vivo. Diante disso, Netanyahu publicou outro vídeo para refutar o boato, que também teve sua autenticidade questionada. Mas os boatos — que acumulam mais de 24 mil interações nas redes — são infundados, segundo especialistas em IA. Além disso, Netanyahu fez diferentes aparições públicas desde então.

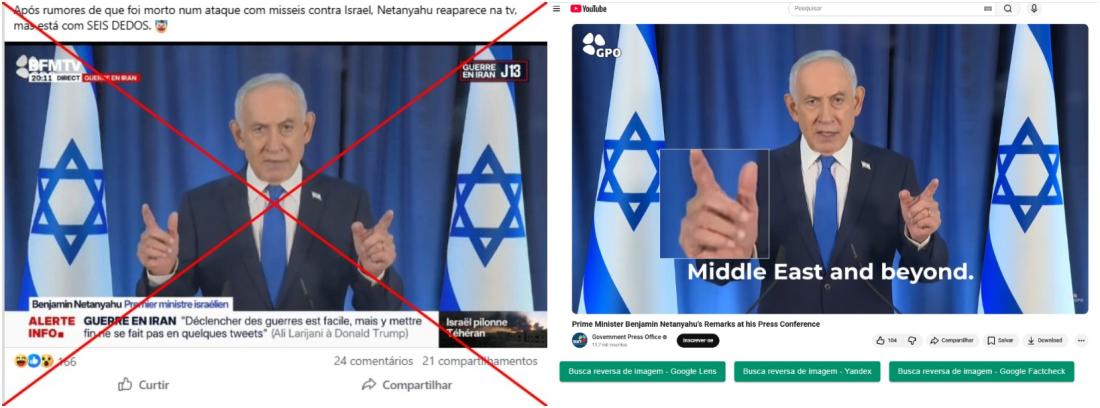

“ATENÇÃO!!! Após rumores de que está ferido, o genocida Netanyahu reaparece, mas está com SEIS DEDOS, indicando que é um vídeo de IA!!! O ‘Netanyahu’ do vídeo diz que está são e salvo e que os bombardeios do Irã não o atingiram! Só que é IA!!!”, diz a legenda que acompanha uma imagem que circula no Instagram, no Facebook, no X e no TikTok.

Conteúdos similares com a imagem circulam em outros idiomas, como francês, inglês, alemão, espanhol, filipino e sueco.

Como indica a marca d’água presente nas imagens, o pronunciamento de Netanyahu foi transmitido pelo canal de televisão BFMTV em 12 de março. Foi a primeira vez que o primeiro-ministro se pronunciou sobre a guerra em conjunto com os Estados Unidos contra o Irã, iniciada em 28 de fevereiro.

No entanto, nas redes sociais internautas começaram a questionar a autenticidade das imagens e a especular que o primeiro-ministro estaria morto com base na suposição de que vídeo teria sido gerado por inteligência artificial. A alegação se baseou em algumas cenas nas quais Netanyahu supostamente estaria com seis dedos visíveis — anomalia frequentemente usada para detectar o uso de IA generativa entre 2023 e 2024 quando ferramentas com a tecnologia foram lançadas.

O rumor sobre a morte do primeiro-ministro surgiu em 10 de março quando a agência semioficial iraniana Tasnim publicou um artigo difundido pela mídia do país que levantava essa possibilidade.

Após alguns dias, um vídeo foi publicado na conta do X de Netanyahu em que ele nega o boato e faz piadas, inclusive sobre o número de dedos em sua mão, em um café de Tel Aviv.

Contudo, novamente internautas questionaram a autenticidade do vídeo e voltaram a alegar que foi gerado por IA.

Vídeo autêntico

Uma busca por palavras-chave identificou a sequência original que baseou as peças de desinformação, publicada em 12 de março no canal oficial de imprensa do governo israelenseo no YouTube.

Ao analisar o vídeo, em nenhum momento são vistos seis dedos nas mãos do primeiro-ministro, mesmo que elas apareçam ligeiramente desfocadas em algumas cenas.

A quantidade de dedos nas mãos é uma característica que se tornou obsoleta para identificar vídeos criados por inteligência artificial, como explicaram especialistas à AFP.

"No caso de um vídeo gerado por IA, geralmente tendem a surgir aberrações e inconsistências de uma tomada para outra", explicou Evangelos Kanoulas, professor de inteligência artificial da Universidade de Amsterdã, à AFP em 17 de março. “E este é uma única pessoa, uma única tomada, que seria, portanto, o cenário mais simples de gerar ", completou.

"Há movimento com as mãos e, em qualquer vídeo, as mudanças de uma cena para a outra podem criar essa impressão de desfoque", analisou, salientando que "basta capturar um momento em que passamos de uma tomada para outra, especialmente se o vídeo estiver comprimido, porque perde qualidade e, portanto, definição e detalhes".

Uma comparação com o vídeo original, que possui uma qualidade superior, permite confirmar o apontado pelo especialista.

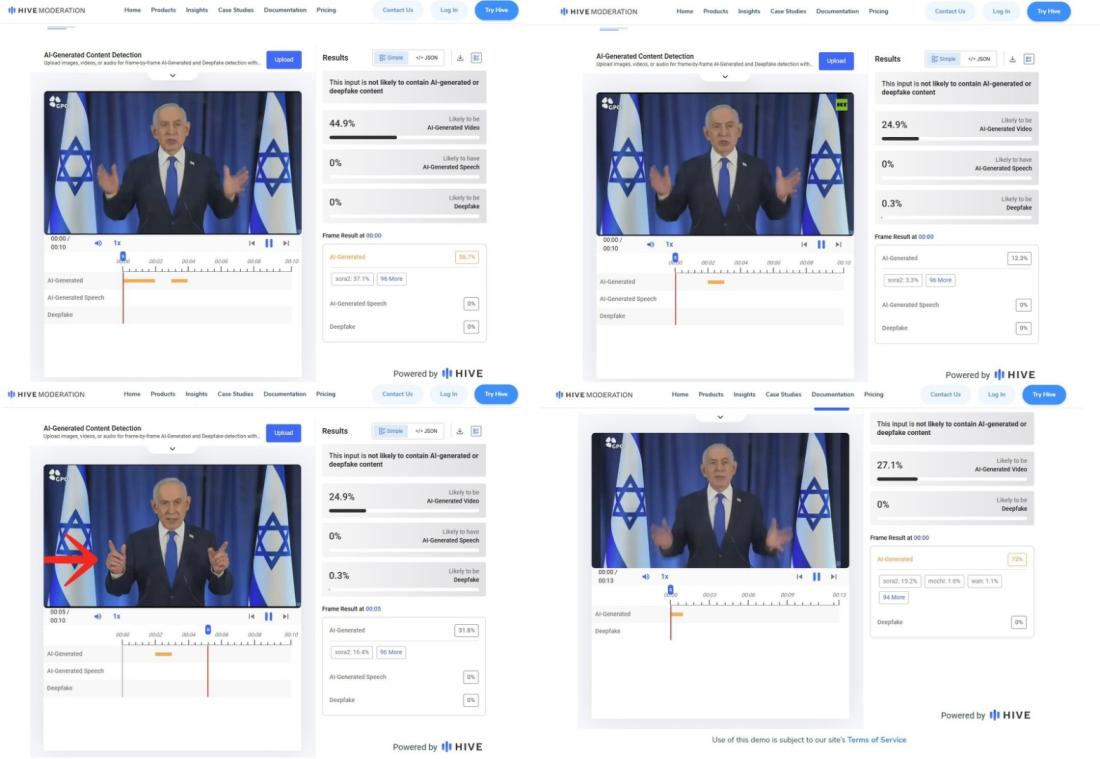

A AFP submeteu a gravação baixada de diferentes fontes e graus de compressão na ferramenta Hive Moderation, que detecta uso de IA para geração de conteúdos, e obteve resultados que variam de 24% a 40% de certeza de ter sido gerado digitalmente.

“De um modo geral, é verdade que os deepfakes deixam vestígios de manipulação de pixels. Portanto, não é sem mérito realizar esse tipo de análise. Mas é preciso verificar a fonte que distribui o vídeo, determinar sua confiabilidade e, sobretudo, analisar o arquivo original e não uma versão comprimida”, apontou Kanoulas, acrescentando que isso pode gerar falsos positivos.

Como explicou à AFP Denis Teyssou, chefe do departamento de inovação dos projetos InVID-WeVerify, “o vídeo do YouTube está em formato webm (formato padrão do Google) e o vídeo do X [usado nas peças de desinformação] foi degradado pela re-codificação [a conversão] para o formato mp4 feita por esta última plataforma".

"A ideia de que um vídeo divulgado pelo governo israelense ou pelos serviços israelenses, que possuem algumas das capacidades tecnológicas mais avançadas do mundo, possa transmitir uma deepfake de seis dedos é, por si só, pouco plausível — seria um nível de incompetência simplesmente inconcebível", acrescenta o especialista em conteúdo sintético e deepfakes Henry Ajder.

Dupla acusação de uso de IA

Os internautas também passaram a alegar que era IA o vídeo publicado pela conta do Netanyahu no X para desmentir a sua morte.

Para sustentar esse boato, são apontados um nariz “fake” do primeiro-ministro, um frame com o copo de café deformado, dedo que supostamente “some do nada”, enquanto outros supostamente estão deformados.

As publicações citam até mesmo as tecnologias de IA, como a Grok do X e do Google, como fontes de confirmação de que a sequência foi criada digitalmente. No entanto, esses chatbots têm sido criticado justamente por erros factuais em eventos atuais.

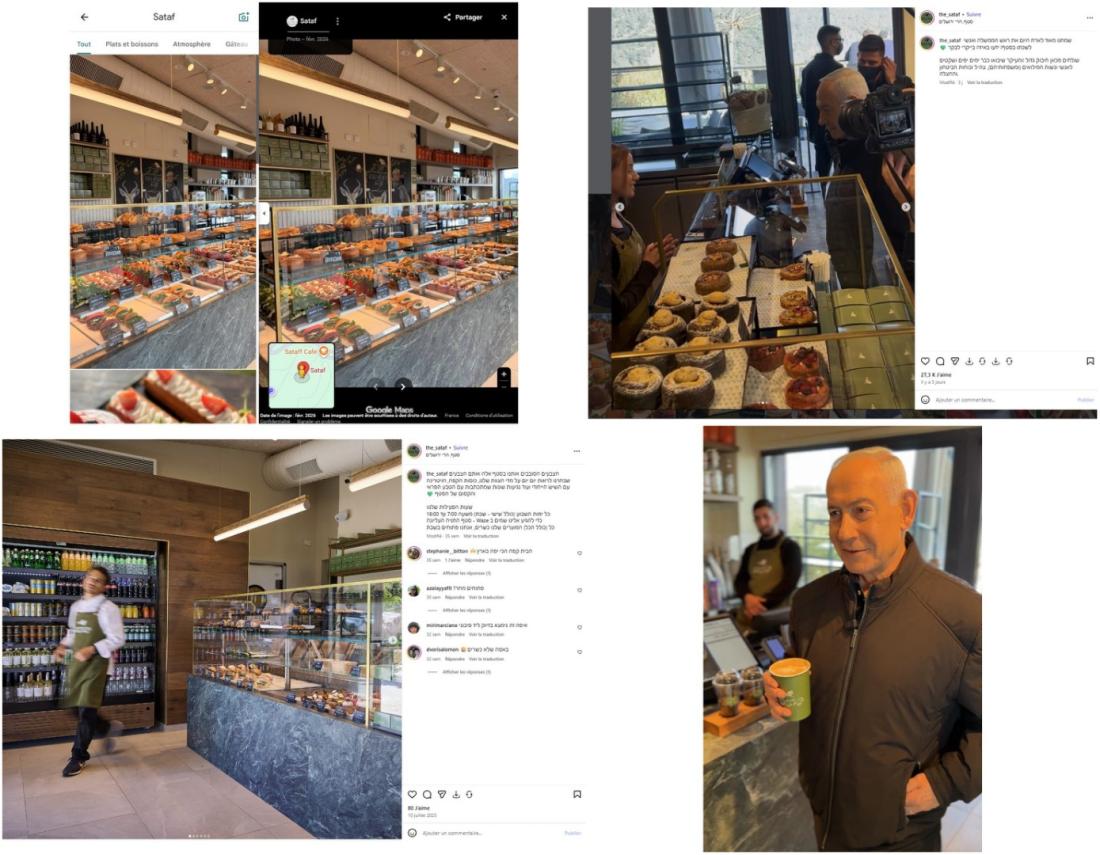

Ajder relembrou que no vídeo são vistos vários ângulos de câmera e que o próprio café em que foi gravado o vídeo publicou uma foto do primeiro-ministro.

O interior da Sataf, uma confeitaria nos arredores de Jerusalém, corresponde ao cenário visto no vídeo.

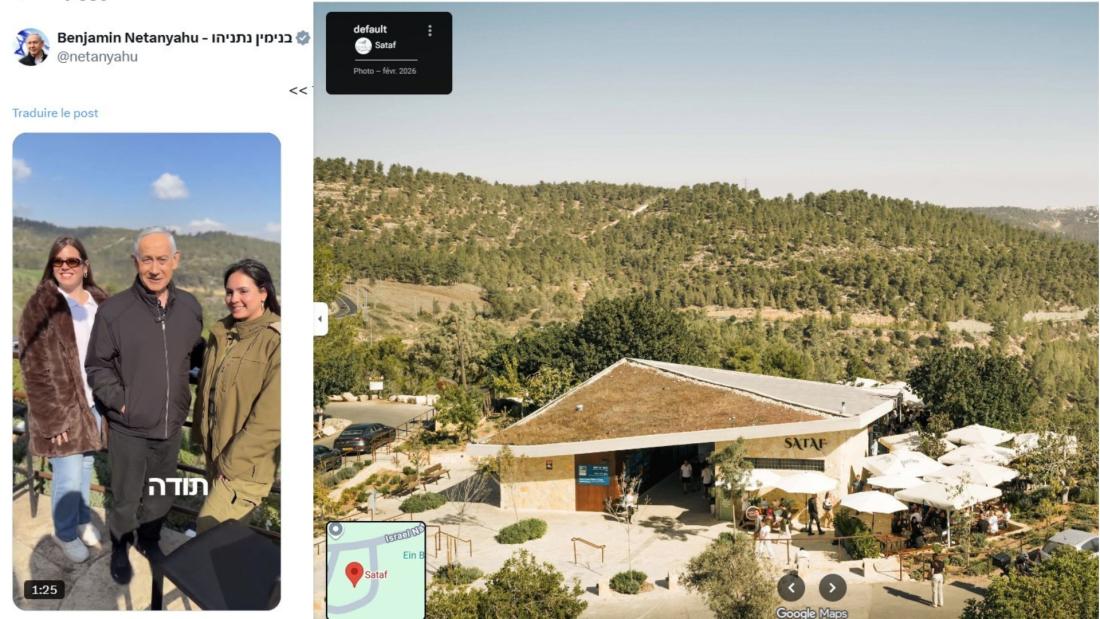

Um vídeo publicado em 16 de março mostra Netanyahu do lado de fora do estabelecimento interagindo com clientes sentados. Ao fundo, vê-se a mesma colina visível nas fotos disponíveis na página da confeitaria no Google Maps.

O copo usado pelo primeiro-ministro no primeiro vídeo, de 15 de março, e o visto na segunda gravação também são os mesmos:

O vídeo em diferentes níveis de compressão foi submetido à ferramenta de detecção de IA, que também apresentou resultados variáveis, sendo que as sequências mais comprimidas e mais curtas obtiveram taxas maiores de detecção de IA, enquanto aquelas mais próximas ao original resultaram em taxas menores.

"Esses modelos de detecção por IA têm suas utilidades, mas também podem contribuir para a disseminação de desinformação online", afirma Ajder. "Os usuários da internet recorrem a esses modelos em busca de conselhos porque está se tornando extremamente difícil distinguir a IA a olho nu, mas, na realidade, esses modelos têm taxas de sucesso e modos de operação muito diferentes de um software para outro".

As capacidades dos softwares de IA estão evoluindo rapidamente, o que torna obsoleto na mesma velocidade os métodos que antes podiam distinguir o seu uso. Em 2018, por exemplo, as deepfakes não piscavam e isso era uma característica evidente de seu uso, mas hoje os modelos já estão treinados para apresentarem versões mais fidedignas nesse sentido.

Outro conteúdo alimenta o boato

O boato sobre a morte de Netanyahu foi compartilhado em outro conteúdo em que um homem vestido com roupas militares se apresenta como um “coronel francês” e confirma a morte do primeiro-ministro israelense.

Mas trata-se de Pascal Treffainguy, um francês que reside no Brasil e que frequentemente publica teorias da conspiração e conteúdo esotérico em suas redes sociais.

A AFP já desmentiu outro conteúdo produzido por Treffainguy.

Em 19 de março, Benjamin Netanyahu concedeu uma coletiva de imprensa, ocasião em que abordou novamente os boatos sobre a sua morte: “Antes de mais nada, quero dizer que estou vivo e vocês são testemunhas disso”, disse ele na transmissão ao vivo.

O primeiro-ministro foi fotografado por fotógrafos na ocasião, e diversas dessas fotos estão disponíveis no AFP Fórum:

O Checamos verificou outros conteúdos sobre a guerra entre Estados Unidos, Israel e Irã.

Referências

- Vídeo original publicado em 12 de março pelo canal de imprensa do governo de Israel

- Especialistas consultados pela AFP (1, 2, 3)

- Vídeo publicado na conta do X de Netanyahu em 16 de março

- Foto publicada pelo Café Sataf

- Imagens do café no Google Maps

- Coletiva de imprensa de 19 de março de Netanyahu

- Notícia sobre Pascal Treffainguy

- Notícia sobre a coletiva de imprensa

- Página do AFP Fórum com imagens de Netanyahu

Copyright © AFP 2017-2026. Qualquer uso comercial deste conteúdo requer uma assinatura. Clique aqui para saber mais.